Файл robots.txt для сайта

Если вы запускаете сайт или занимаетесь его продвижением, рано или поздно столкнётесь с файлом robots.txt. Одни настраивают его интуитивно и допускают ошибки, которые стоят трафика, другие не трогают вовсе и теряют позиции из-за лишних страниц в индексе поисковых систем. Разобраться в нём несложно, если знать основные принципы работы.

В статье разберём синтаксис и все основные директивы, рассмотрим готовые примеры для WordPress и Битрикс, объясним разницу между robots.txt и noindex, расскажем, как заблокировать AI-роботов и как проверить файл онлайн. Материал подойдёт и владельцам сайтов, которые впервые слышат про robots.txt, и SEO-специалистам, которым нужен актуальный справочник под рукой на каждый день.

Что такое robots.txt и зачем он нужен

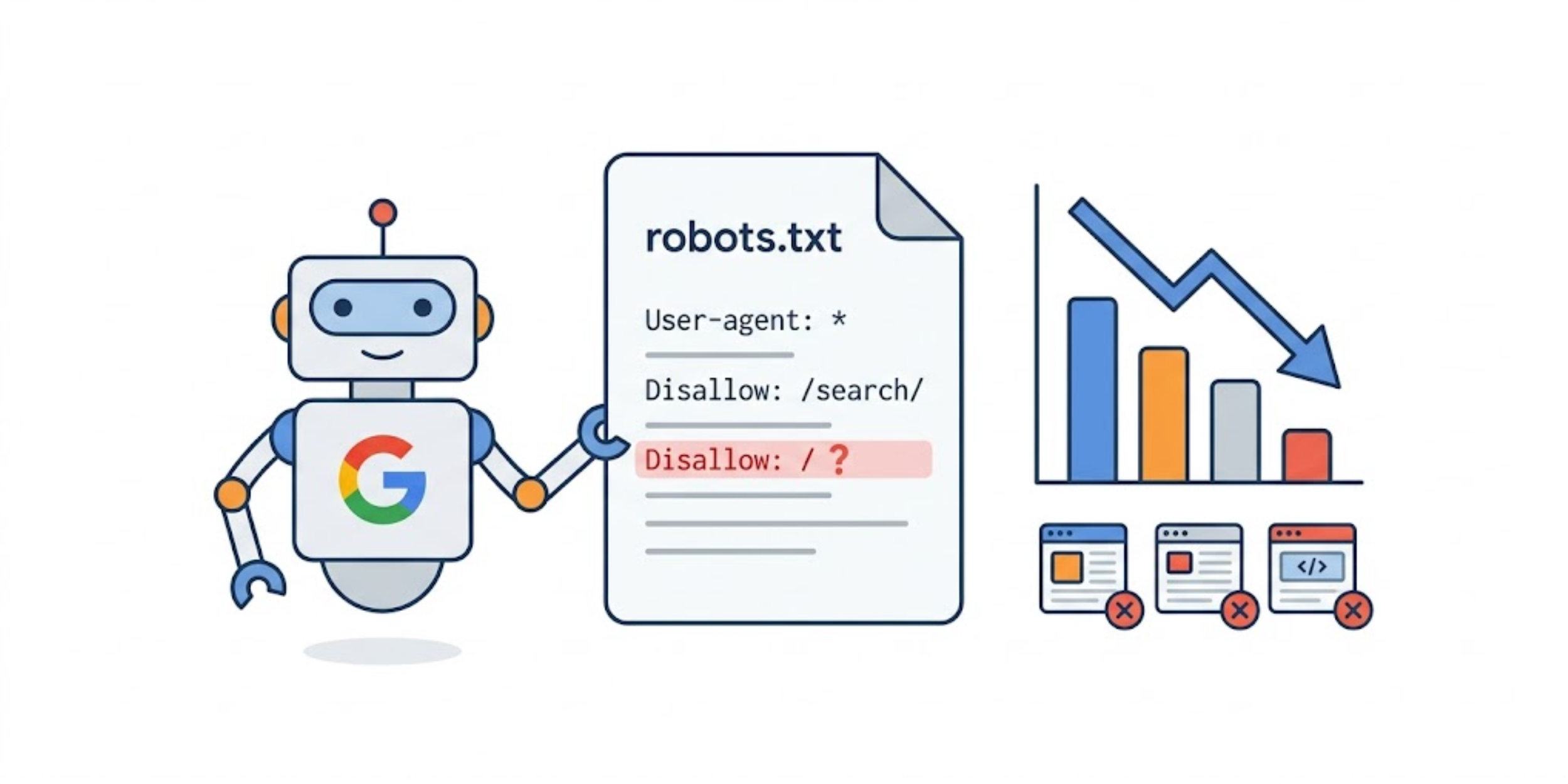

Когда поисковый робот приходит на сайт, первым делом он обращается по адресу yoursite.ru/robots.txt. Это небольшой текстовый файл в корне сайта, который сообщает роботу, какие страницы и разделы можно сканировать, а какие стоит пропустить. Именно с этого файла начинается любое знакомство поискового бота с вашим ресурсом.

Файл работает в рамках Robots Exclusion Protocol — стандарта, которому добровольно следуют Google, Яндекс, Bing и большинство других поисковиков. Механизм полностью построен на доверии: порядочные боты соблюдают правила файла, а спам-парсеры и сканеры уязвимостей вполне могут его проигнорировать без каких-либо последствий.

С помощью robots.txt можно запрещать сканирование отдельных страниц и целых разделов, указывать расположение карты сайта, задавать паузу между запросами краулера, чтобы не перегружать сервер, а также настраивать отдельные правила для каждого конкретного робота независимо от других.

Чего robots.txt не умеет

Главное заблуждение состоит в том, что robots.txt скрывает страницы из поисковой выдачи. Если на закрытую страницу ведут внешние ссылки с других сайтов, Яндекс или Google всё равно могут показать её в результатах поиска, просто без описания и текстового сниппета под заголовком.

Ещё один распространённый миф состоит в том, что robots.txt защищает данные от посторонних. На самом деле любой человек может открыть ваш файл в браузере и увидеть все закрытые разделы. Нередко это буквально карта чувствительных мест сайта с адресами /admin/, /backup/ и /internal-api/ как на ладони.

Хочу обратить особое внимание на то, что robots.txt не заменяет тег noindex, это два разных инструмента с разными задачами. Чтобы убрать страницу из поиска, нужен мета-тег noindex, а не запрет в robots.txt. Сам файл решает другую задачу и помогает управлять тем, куда тратится краулинговый бюджет сайта при обходе. Об этом многие забывают, а часто и просто не видят разницы.

Сергей Крившук

Генеральный директор ООО "Группа Тэта"

Где находится файл robots.txt

Файл robots.txt всегда размещается в корневой директории сайта и должен быть доступен по адресу yoursite.ru/robots.txt. Поисковые роботы ищут его именно там и нигде больше — разместить файл в подпапке или на другом уровне не получится, бот его просто не найдёт и будет сканировать сайт без каких-либо ограничений с вашей стороны.

Важно понимать, что файл привязан к конкретному домену и не распространяется на субдомены автоматически. Если у вас есть blog.yoursite.ru или shop.yoursite.ru, для каждого из них нужен отдельный robots.txt, размещённый в корне соответствующего субдомена, иначе роботы будут сканировать его целиком без каких-либо ограничений.

Файл должен называться именно robots.txt — строчными буквами, без пробелов и дополнительных символов. Кодировка обязательно UTF-8, иначе поисковики могут некорректно прочитать содержимое файла. Создать его можно в любом текстовом редакторе — Блокноте, Notepad++ или VS Code, но не в Word, поскольку он добавляет скрытые символы форматирования, которые ломают структуру файла.

Как разместить файл на сайте

Способ загрузки зависит от платформы и хостинга. На обычном хостинге файл загружают через FTP-клиент или файловый менеджер в панели управления в папку public_html или www. В WordPress файл можно создать вручную через FTP или управлять им через плагины Yoast SEO и Rank Math прямо из административной панели без доступа к серверу. В Битрикс файл размещается в корне сайта через административную панель или FTP, а на Tilda robots.txt редактируется в настройках сайта в разделе SEO.

Синтаксис и директивы robots.txt

Файл состоит из блоков, каждый из которых описывает правила для одного или нескольких роботов. Блок всегда начинается с директивы User-agent, за которой следуют инструкции Disallow и Allow. Между блоками обязательно ставится пустая строка, иначе правила склеятся и будут работать некорректно.

Комментарии в файле начинаются с символа # и не обрабатываются роботами. Их удобно использовать для пояснений прямо внутри файла. Каждая директива пишется с новой строки, в одной строке может быть только одна инструкция — это важное правило, нарушение которого приводит к непредсказуемому поведению краулеров на сайте.

Пути в директивах чувствительны к регистру, то есть /Admin/ и /admin/ для робота разные адреса. Файл должен быть написан только на латинице в части директив, кириллица допустима лишь в комментариях. Порядок директив внутри блока не имеет значения, однако принято сначала писать Disallow, а потом Allow для удобства чтения.

Основные директивы файла Robots.txt

- User-agent указывает, для какого робота действуют правила блока. Звёздочка означает всех роботов сразу, конкретное имя — только одного бота. Можно перечислить несколько User-agent подряд перед одним набором правил.

- Disallow запрещает роботу сканировать указанный путь. Если значение не указано совсем, директива разрешает доступ ко всему сайту. Disallow: / с одним слешем закрывает весь сайт полностью для указанного робота.

- Allow разрешает сканирование конкретного пути и используется для исключений внутри закрытых разделов. При конфликте между Allow и Disallow побеждает более длинный и конкретный путь, а не тот, что стоит выше в файле.

- Sitemap указывает полный адрес XML-карты сайта. Директива помогает роботу быстрее обнаружить все страницы и ускоряет индексацию. Можно указать несколько Sitemap подряд, если карт несколько.

- Crawl-delay задаёт паузу в секундах между запросами робота к серверу. Яндекс её поддерживает и соблюдает, Google официально игнорирует — для управления скоростью Googlebot используется Google Search Console.

- Host — это директива только для Яндекса. Указывает предпочтительное зеркало сайта и помогает избежать проблем с дублями на www и без www. Google эту директиву не поддерживает и просто пропускает.

Примеры файлов robots.txt

Открыть весь сайт для индексации

Самый простой вариант — разрешить всем роботам сканировать весь сайт без ограничений. Пустое значение после Disallow означает отсутствие запретов, а строка с Sitemap помогает роботу быстрее найти все страницы сайта.

User-agent: *

Disallow:

Sitemap: https://example.com/sitemap.xmlЗакрыть весь сайт от индексации

Такой вариант используют для тестовых сайтов, страниц в разработке или ресурсов, которые временно не должны появляться в поиске. Важно помнить, что уже проиндексированные страницы останутся в выдаче — этот способ лишь останавливает новое сканирование.

User-agent: *

Disallow: /Закрыть отдельные разделы

Самый распространённый случай — разрешить сканирование основного контента и закрыть служебные разделы, которые не нужны в поиске и лишь расходуют краулинговый бюджет впустую.

User-agent: *

Disallow: /admin/

Disallow: /search/

Disallow: /cart/

Disallow: /checkout/

Disallow: /personal/

Allow: /

Sitemap: https://example.com/sitemap.xmlРазные правила для разных роботов

Иногда нужно настроить поведение отдельно для каждого поисковика. Например, закрыть раздел для Googlebot, но оставить его открытым для Яндекса, или наоборот.

User-agent: Googlebot

Disallow: /no-google/

User-agent: Yandex

Disallow: /no-yandex/

User-agent: *

Disallow: /admin/

Sitemap: https://example.com/sitemap.xmlРазрешить один файл внутри закрытой папки

Бывает нужно закрыть целый раздел, но оставить доступ к одному конкретному файлу внутри него. Allow с более длинным путём перекрывает общий запрет Disallow.

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.phpRobots.txt для WordPress

WordPress генерирует файл robots.txt динамически через PHP, физического файла на сервере по умолчанию нет. Если вы создадите файл вручную и загрузите его в корень сайта через FTP, WordPress будет использовать именно его, игнорируя собственную генерацию. Плагины Yoast SEO и Rank Math перехватывают управление и позволяют редактировать файл прямо из административной панели.

По умолчанию WordPress начиная с версии 5.5 генерирует минимальный файл, который закрывает только папку /wp-admin/ и разрешает /wp-admin/admin-ajax.php. Этого недостаточно для большинства сайтов, поскольку остаются открытыми страницы поиска, архивы авторов, фиды и другие разделы, которые создают дубли и расходуют краулинговый бюджет без какой-либо пользы.

Ниже приведён актуальный пример файла для WordPress, который закрывает всё лишнее и при этом оставляет доступ к изображениям, скриптам и стилям — без них поисковик не сможет корректно отобразить сайт в результатах поиска.

User-agent: *

Disallow: /wp-admin/

Disallow: /wp-includes/

Disallow: /wp-login.php

Disallow: /xmlrpc.php

Disallow: /?s=

Disallow: /search/

Disallow: /author/

Disallow: /feed/

Disallow: */embed

Allow: /wp-admin/admin-ajax.php

Allow: /wp-content/uploads/

Allow: /wp-*.css

Allow: /wp-*.js

Allow: /

Sitemap: https://example.com/sitemap_index.xmlЧто и почему закрываем

- /wp-admin/ — административная панель, не нужна в поиске ни при каких обстоятельствах.

- /wp-includes/ и /wp-login.php — системные файлы WordPress.

- /xmlrpc.php — устаревший API, его лучше закрыть и по соображениям безопасности.

- /?s= и /search/ — страницы внутреннего поиска, которые дублируют контент.

- /author/ — архивы авторов, на небольших сайтах это почти всегда дубли страниц с постами.

- /feed/ и /embed — RSS-ленты и встраивания, которые не нужны в индексе.

Robots.txt и noindex — что и когда использовать

Это один из самых частых источников путаницы в SEO. Многие считают эти инструменты взаимозаменяемыми, но у каждого своя задача, и неправильный выбор может привести к противоположному результату — страница либо останется в индексе вопреки желанию, либо выпадет из него случайно.

Robots.txt управляет сканированием — он говорит роботу, заходить на страницу или нет. Тег noindex управляет индексацией — он говорит роботу, добавлять страницу в поиск или нет. Разница принципиальная: робот может знать о существовании страницы и показывать её в выдаче, даже ни разу не зайдя на неё, если на неё ведут внешние ссылки.

Самая распространённая ошибка выглядит так: вебмастер закрывает страницу через Disallow в robots.txt и думает, что она исчезнет из поиска. Но если на эту страницу ссылаются другие сайты, поисковик видит её через эти ссылки, заносит URL в базу и показывает в выдаче — просто без описания и сниппета.

Когда использовать robots.txt

Robots.txt подходит для разделов, которые не должны тратить краулинговый бюджет: административные панели, служебные скрипты, страницы корзины и оформления заказа, внутренний поиск, технические файлы системы. Эти страницы не нужны в индексе, и внешних ссылок на них нет, поэтому запрет через robots.txt работает корректно.

Когда использовать noindex

Тег noindex нужен там, где важно гарантированно убрать страницу из поиска независимо от внешних ссылок. Это страницы с дублированным контентом, личные кабинеты пользователей, страницы с UTM-метками, тонкие страницы тегов и категорий без уникального контента, а также любые страницы, которые могут получить внешние ссылки.

Главное правило

Никогда не используйте оба инструмента одновременно для одной страницы. Если закрыть страницу через Disallow в robots.txt и одновременно поставить на ней noindex, робот не зайдёт на страницу и не увидит тег. В результате noindex не сработает, а страница может остаться в индексе навсегда.

AI-роботы и как их заблокировать

С появлением больших языковых моделей в интернете появился новый тип ботов — AI-краулеры. Они сканируют сайты не для поисковой индексации, а для сбора данных, на которых обучаются нейросети. OpenAI, Anthropic, Common Crawl, Google и другие компании запустили собственных роботов, которые методично обходят весь доступный веб.

Формально эти боты соблюдают robots.txt, поэтому заблокировать их можно стандартными средствами. Вопрос о том, стоит ли это делать, каждый владелец сайта решает сам. Одни считают, что их контент не должен использоваться для обучения моделей без разрешения и вознаграждения, другие не возражают против такого сканирования и оставляют доступ открытым.

Если вы хотите закрыть сайт от AI-краулеров, добавьте в robots.txt отдельные блоки для каждого бота. Делать это нужно именно отдельными блоками, а не через универсальный User-agent: *, чтобы не затронуть правила для поисковых систем и не навредить индексации основного контента сайта.

User-agent: GPTBot

Disallow: /

User-agent: ChatGPT-User

Disallow: /

User-agent: ClaudeBot

Disallow: /

User-agent: anthropic-ai

Disallow: /

User-agent: CCBot

Disallow: /

User-agent: Google-Extended

Disallow: /

User-agent: Amazonbot

Disallow: /

User-agent: Bytespider

Disallow: / Что означает каждый бот

- GPTBot и ChatGPT-User — роботы OpenAI для обучения моделей и плагинов ChatGPT

- ClaudeBot и anthropic-ai — роботы Anthropic, компании-разработчика Claude.

- CCBot — робот Common Crawl, открытой базы данных веб-страниц, которую используют многие AI-компании

- Google-Extended — отдельный робот Google для обучения Gemini и других AI-продуктов компании

- Amazonbot и Bytespider — роботы Amazon и ByteDance соответственно

Как проверить robots.txt

Перед тем как файл начнёт влиять на индексацию, его стоит проверить — даже небольшая опечатка в пути может случайно закрыть важный раздел или, наоборот, оставить открытым то, что должно быть скрыто от роботов. Проверка занимает несколько минут и избавляет от проблем, которые иначе обнаруживаются только через месяц по просадке трафика.

Самый простой способ посмотреть текущий файл — просто добавить /robots.txt к адресу любого сайта в браузере. Это работает для любого домена, файл всегда в открытом доступе. Так можно не только проверить собственный сайт, но и посмотреть, как настроены файлы у конкурентов или крупных площадок для ориентира.

Google Search Console

Наиболее надёжный инструмент для проверки — встроенный тестер в Google Search Console. Он показывает актуальную версию файла, которую видит Googlebot, и позволяет проверить любой конкретный URL — заблокирован он или нет. Найти его можно в разделе «Настройки — Сканирование — Файл robots.txt».

Яндекс Вебмастер

У Яндекса есть аналогичный инструмент в разделе «Инструменты — Анализ robots.txt». Он позволяет проверить, как Яндекс читает ваш файл, протестировать доступность любого URL и увидеть, какое именно правило срабатывает для конкретного адреса. Особенно полезен при настройке директив Host и Clean-param.

Онлайн-валидаторы

Если нет доступа к Search Console или нужно быстро проверить файл до публикации, можно воспользоваться сторонними сервисами. Sitechecker и Screaming Frog позволяют проверить синтаксис и логику файла, найти конфликты между Allow и Disallow и убедиться, что нужные страницы открыты для сканирования.

Типичные ошибки в robots.txt

Большинство ошибок в robots.txt не бросаются в глаза сразу — сайт продолжает работать, страницы открываются, но трафик постепенно падает или важные разделы выпадают из индекса. Обнаружить проблему без целенаправленной проверки сложно, поэтому лучше знать наиболее распространённые ошибки заранее и не допускать их с самого начала.

Закрыть весь сайт и забыть открыть

Самая катастрофическая ошибка — перенести сайт с тестового домена на основной и забыть убрать Disallow: / из файла. Сайт перестаёт индексироваться, трафик падает до нуля, а владелец замечает это только через несколько недель, когда позиции уже потеряны. Всегда проверяйте robots.txt сразу после переноса или запуска сайта.

Закрыть нужные файлы вместе с ненужными

Частая ошибка в WordPress — закрыть папку /wp-content/ целиком, пытаясь спрятать системные файлы. Вместе с ними закрываются изображения, стили и скрипты из папки /uploads/, без которых поисковик не может корректно отобразить страницы сайта. То же касается закрытия /wp-includes/ без исключений для нужных ресурсов.

Путать Disallow: / и Disallow без значения

Disallow: / с одним слешем закрывает весь сайт. Disallow: без значения после него не закрывает ничего и означает полный доступ. Эти две директивы выглядят похоже, но работают противоположно. Ошибка в один символ может полностью закрыть сайт от индексации или полностью его открыть.

Не разделять блоки пустой строкой

Если между блоками разных User-agent нет пустой строки, роботы воспринимают их как один блок с несколькими агентами. Правила применяются не так, как задумано, и отладить такое поведение без специального инструмента крайне сложно. Всегда разделяйте блоки одной пустой строкой без исключений.

Использовать noindex и Disallow одновременно

Если закрыть страницу через Disallow в robots.txt и одновременно поставить на ней тег noindex, робот не зайдёт на страницу и не увидит тег. Noindex не сработает, и страница может остаться в индексе. Эти два инструмента нельзя использовать вместе для одной и той же страницы.

Не указывать Sitemap

Многие владельцы сайтов настраивают запреты, но забывают добавить в файл ссылку на карту сайта. Sitemap помогает роботу быстрее обнаружить все нужные страницы и ускоряет индексацию новых материалов. Это одна строка, которая при этом ощутимо влияет на скорость появления страниц в поиске.

Вывод

Robots.txt — небольшой файл, но его влияние на индексацию сайта трудно переоценить. Правильно настроенный файл помогает поисковикам сосредоточиться на важных страницах, экономит краулинговый бюджет и защищает служебные разделы от попадания в индекс. Неправильно настроенный способен обнулить весь органический трафик буквально одной строкой.

Главное, что стоит запомнить: robots.txt управляет сканированием, а не индексацией. Это разные вещи, и путаница между ними приводит к большинству серьёзных ошибок. Для управления видимостью страниц в поиске используйте тег noindex, для управления доступом краулеров — robots.txt, и никогда не смешивайте эти инструменты для одной и той же страницы.

Проверяйте файл после каждого значимого изменения на сайте — после переработки дизайна, смены CMS, добавления новых разделов или переезда на другой домен. Пять минут в Google Search Console или Яндекс Вебмастере могут сэкономить недели работы по восстановлению потерянных позиций и возврату трафика обратно на сайт.